Prasa Hi-fi zajmuje się intensywnym lansowaniem płyt winylowych i sprzętu do ich odtwarzania. Promowanie zapisu mechanicznego jest absurdem, bo jest metodą ustępującą pod każdym względem nowszym technikom już nie tylko pod względem jakości, ale przede wszystkim komfortu i trwałości.

Płyta winylowa jest nośnikiem trwałym wtedy, gdy nie jest odtwarzana, każdorazowe jej zagranie powoduje degradację zapisu. Najszybciej można zorientować się w skali zjawiska, jeśli igła zostanie opuszczona na czyste miejsce. Okaże się, że igła zostawi na płycie wgniecenie. Zamiast płyt można użyć płytki CD albo DVD. Po opuszczeniu igły na płytę obracamy powoli talerz gramofonu. Każdy ruch pozostawia na płycie ślad. Jeśli się użyje do regulacji siły dośrodkowej czystej płyty lub płytki CD/DVD okaże się, że powierzchnia płyty jest mocno porysowana. Płyty winylowe stwarzają problemy jeśli trzeba ich użyć do wykonania pomiarów, np. wkładki. Zapis po każdym odtworzeniu ulega starciu i dlatego w pewnym momencie pomiary nie są już miarodajne.

Na płycie winylowej można z pewnymi ograniczeniami zapisać pełne pasmo, ale trudność sprawia odczyt.

Jedyną szansą na niezniekształcony odczyt wysokich częstotliwości dla fragmentu płyty w pobliżu jej środka jest gramofon laserowy. Średnica promienia lasera śledzącego zapis jest znacznie mniejsza niż rozmiary igły gramofonowej. Typowa igła nie zmieści się w najgęstsze składniki zapisu. Poniższy rysunek przedstawia wielkość realnej igły i teoretyczną wymaganą. Jednak w praktyce nie jest możliwe wykonanie szlifu z tak małymi krzywiznami.

Jakość dźwięku jest tym gorsza im bliżej środka. Producenci przeciwdziałają temu w ten sposób, że dla końcowych minut zapisu modyfikują go zmniejszając ilość najwyższych częstotliwości. Kształtowanie dźwięku, żeby uniknąć zniekształceń jest powodem ukucia terminu "ciepły dźwięk analogu". Nie ma możliwości nacięcia matrycy z normalną ilością wysokich tonów. Powody są dwa. Przede wszystkim głowica nacinająca nie jest w stanie naciąć większej ilości wysokich tonów bez zniekształceń. Po drugie większa, czyli zwyczajna nawet dla nagrań wykonanych analogowo, ilość wysokich tonów spowoduje przegrzanie się i być może nawet spalenie głowicy.

Zbyt duża dynamika zapisu spowoduje przeciążenie samej wkładki gramofonowej, która może nie być w stanie śledzić dużych amplitud. Z kolei, jak to widać na rysunkach, większa amplituda wysokich tonów w granicach możliwości głowicy nacinającej będzie niemożliwa do śledzenia przez bardziej proste szlify igły. Igła sferyczna nie ma szans, igła eliptyczna nie zawsze będzie w stanie zmieścić się w gęstym zapisie, jedynie najbardziej zaawansowane kształty igły mogłyby sprostać zadaniu, ale i tak nie udałoby się poprawnie odczytać płyty naciętej 1:1 z typowego pliku. Odczytać górę pasma bez zniekształceń można, ale tylko wtedy, kiedy amplituda nie przekroczy pewnej wielkości, czyli zawsze trzeba ściszyć wysokie tony.

Paradoksalnie lepsza jakość zapisu na płytach nacinanych systemem DMM skutkuje gorszą jakością odtwarzania, bo głośniejszy i zawierający bardziej normalną ilość wysokich tonów dźwięk jest nie do odtworzenia przez tańsze wkładki ze sferycznym szlifem igły.

Dlatego, że mało kto używa referencyjnych wkładek, producenci nacinają płyty bardziej zachowawczo niż to by było konieczne dla najlepszych systemów. Ale nawet bezkompromisowo nacięta płyta nie jest w stanie dorównać dynamiką i jakością zapisowi cyfrowemu. Poza tym problemem są matryce z lakierem. Źle nacięte powodują przesłuchy pomiędzy sąsiadującymi rowkami, spada dynamika, wzrastają zniekształcenia. Za gorące ostrze - lakier będzie się topił i płynął. Za zimne - lakier będzie się ciągnął jak guma. W obu przypadkach wzrosną zniekształcenia i spadnie dynamika. Dlatego nacięcie płyty jest sztuką. I z całą pewnością nikt w Polsce nigdy nie naciął acetatu prawidłowo. Najczęstsza wada polskich płyt to preecho kiedy słychać dźwięk przebity z sąsiedniego rowka. Właśnie dlatego często utwory zaczynają się "dwa razy". Raz bardzo cicho, a potem zwyczajnie. Trzeba jednak mieć świadomość tego, że ten przesłuch dotyczy całej płyty. Słychać go zazwyczaj na początku, ale występuje cały czas. Sprawdzić: "Zdzisław Piernik – Tuba" Polskie Nagrania.

Mało kto zadaje sobie pytanie jakiego poziomu zakłóceń można się spodziewać po samej płycie. Jeśli płyta jest wykonana ze szczególną starannością, zakłócenia będą wyglądać następująco:

Na wykresie spektrum zakłóceń od płyty (razem z zakłóceniami z gramofonu, ale te są bardzo małe) jest zaznaczone kolorem czerwonym. Po uśrednieniu okazuje się, że dla 20 Hz odstęp od zakłóceń jest tylko 65 dB, dla 100 Hz 80 dB i dopiero powyżej 200 Hz zakłócenia spadają do -90 dB. Ale nie znaczy to, że odstęp od szumu dla płyty winylowej wynosi 90 dB. Taki odstęp od zakłóceń jest od 200 do 500 Hz. Winyl szumi dosyć głośno i nie sposób tego nie usłyszeć. Zakłócenia w zakresie niskich częstotliwości na płytach z muzyką są większe niż na płytach testowych. Starsze płyty mają dość bogate spektrum przeróżnych całkiem głośnych zakłóceń. Ważony odstęp od zakłóceń dla dobrego gramofonu to zaledwie 70 dB.

Jakim poziomem zniekształceń jest obarczony zapis na samej płycie? Nacinanie płyty odbywa się na granicy wytrzymałości termicznej głowicy. Towarzyszą temu również problemy mechaniczne, które powodują powstanie zniekształceń. Każdy, kto słuchał kiedykolwiek płyt winylowych wie, że dźwięk nie jest zupełnie czysty.

Głowica nacinająca jest sterowana wzmacniaczem o mocy kilkuset wat. Można przyjąć dla uproszczenia, że wzmacniacz ma 2x1000W - dwa kilowaty. Nie dziwi więc, że przy takich mocach uzwojenie głowicy może się przegrzać i spalić.

Dlaczego trzeba użyć takich mocy? Dlatego, że głowica ma pewną masę i może być tłumiona wyłącznie mechanicznie. Głośniki niskotonowe są tłumione zarówno mechanicznie, przez zawieszenie górne i dolne, ale też elektrycznie. Tłumienie elektryczne wiąże się z osławionym współczynnikiem tłumienia. W przypadku głowicy nacinającej nie jest możliwe tłumienie elektryczne z wielu względów. Jednak właśnie dlatego, że jest możliwe tłumienie tylko mechaniczne, głowica musi być zawieszona bardzo twardo. Tak twarde zawieszenie jest konieczne, bo zniekształcenia w przeciwnym razie będą zbyt duże. I przede wszystkim stąd biorą się tak duże moce wzmacniaczy. Warto się nad tym przez chwilę zastanowić: dwa kilowaty, żeby wychylenie wyniosło mniej niż milimetr. Kilowat na część milimetra w jednym kanale i kilowat na część milimetra w drugim.

Jeśli chodzi o wydania zagraniczne trzeba wprawnego ucha, żeby wychwycić zniekształcenia, bo specjaliści nacinający matryce świetnie orientują się w ograniczeniach i możliwościach sprzętu, więc mogą tak wpłynąć na dźwięk, żeby nie dopuścić do przeforsowania głowicy. Jak się to robi, to dość obszerny temat, głównie wpływa się na barwę obniżając ilość wysokich tonów i spłaszcza impulsy. Jednak w Polsce osoby nacinające płyty raczej nie miały wystarczającej wiedzy i umiejętności, a być może także nie miały do dyspozycji odpowiednich narzędzi. W każdym razie prawie zawsze można usłyszeć zniekształcenia na polskich wydawnictwach. Dowodzi to, że zapis na płycie ma duże ograniczenia i jeśli się nie podejmie odpowiednich kroków, wyjdą one na jaw w pełnej krasie.

W latach siedemdziesiątych, posługiwano się często sprzętem do nacinania matryc, który miał zniekształcenia rzędu jeden-dwa procenty, ale taki poziom zniekształceń może się utrzymać najwyżej do połowy strony, dalej będzie już znacznie gorzej, a finał opery na końcu strony - szkoda słów. I te zniekształcenia są na tych płytach. Nie zawsze je słyszymy, ale one są, a są trudne do uchwycenia, bo nie mamy możliwości porównania jak brzmi master.

Zobaczmy teraz jak się sprawy mają w odniesieniu do sprzętu odtwarzającego.

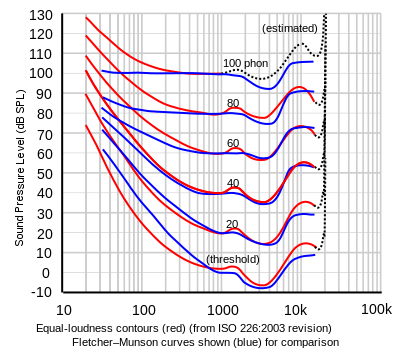

Jeśli chodzi o wkładki gramofonowe, to typowa charakterystyka częstotliwościowa wygląda w ten sposób:

Na schemacie jest widoczny garb w okolicach 20 kHz. Występuje on zawsze bez względu na typ wkładki i jest spowodowany rezonansem gumowego zawieszenia wspornika igły. Nie ma opcji, żeby tego uniknąć, a częstotliwość rezonansu zawiera się w przedziale 15-25 kHz. Parametr podawany dla wkładki czyli zniekształcenia wysokich tonów jest tak ważny, bo świadczy m.in. o tym jak dobrze udało się producentom uporać z rezonansem. Zazwyczaj wielkość zniekształceń wysokich tonów wynosi 0,1% jednak nie ma informacji dla jakich częstotliwości się je mierzy. Wydaje się, że pomiar następuje dla częstotliwości jeszcze nie dotkniętych rezonansem czyli około 10 kHz. Dla częstotliwości rezonansowych na pewno by się nie udało zejść ze zniekształceniami do tak niskiego poziomu.

Ale rezonans zawieszenia igły nie ma nic wspólnego z innym rezonansem.

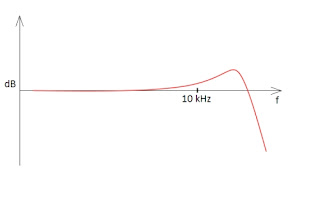

Powyższy schemat pokazuje charakterystykę dla przedwzmacniacza MM. Podbicie wynika z nieodpowiednich parametrów przedwzmacniacza. Poniższy schemat jest w zasadzie obwodem rezonansowym. Od lewej: silnik wkładki, indukcyjność wkładki, opór wkładki, pojemność kabla, pojemność przedwzmacniacza i jego opór. Problem sprawiają zbyt duże C2 i R2

W skrajnych przypadkach podbicie wysokich tonów może sięgnąć nawet ponad 6 dB. Okazuje się jednak, że nie tylko wkładki MM nastręczają problemów. Również układy MC są podatne na zmiany parametrów obciążenia, przy czym głównie dotyczy to oporu. Jednak również pojemność może odgrywać pewną rolę, co widać na rysunku poniżej.

Dla wkładek MC ważniejszy jest opór i jego wpływ na charakterystykę jest pokazany na schemacie poniżej.

Kombinacja obu parametrów może wyglądać następująco:

Wobec tego nawet w przypadku wkładek MC, które miały zapewnić bardziej liniową charakterystykę, bo odpada problem niedopasowania pojemności, można napotkać trudności. Najczęściej podaje się przykład wkładki Denon DL 103 jako nie pasującej do standardowego wejścia przedwzmacniacza gramofonowego, które ma przeważnie 100 ohm, natomiast dla tej wkładki minimum to 470 ohm.

Jitter jest parametrem, który działa na audiofilów jak czerwona płachta na byka. Okazuje się, że odpowiednik jittera w analogu czyli kołysanie dźwięku jest o wiele rzędów wielkości większy i... nikomu to nie przeszkadza.

|

| Wszystkie zakłócenia wynikające z kołysania dźwięku są powyżej -90 dB. Natomiast zakłócenia jitter są zawsze poniżej -90 dB. Poza tym spora część zakłóceń od kołysania dźwięku jest już na tyle głośna, że słyszalna - wszystko co ponad -50 dB słychać. |

Ten wykres jest odpowiednikiem jitteru. Warto porównać jak wygląda ta sytuacja dla systemu cyfrowego w odniesieniu do przetworników i nietrudno zauważyć, że kołysanie w analogu jest nieporównywalnie silniejsze. Analizując wykres pokazujący równomierność obrotów gramofonu wykres trzeba mieć na uwadze, że wszystko co jest ponad -50 dB jest słyszalne. Natomiast w przeciwieństwie do odczytu mechanicznego jitter w systemie cyfrowym jest na poziomie gwarantującym całkowitą nieszkodliwość. Na wykresie jitteru mamy pośrodki tylko linię reprezentującą sygnał użyteczny, natomiast zakłócenia występują co najmniej 90 dB niżej. Wykres pokazujący kołysanie dźwięku w gramofonie analogowym właściwie w całości składa się z zakłóceń. Wszystko na tym wykresie to zakłócenia. Sygnał można zauważyć tylko i wyłącznie na samym szczycie tego jęzora i jest dosłownie zakryty zakłóceniami, które są one bardzo duże zaledwie 10 dB poniżej poziomu sygnału odniesienia.

Odczyt zapisu mechanicznego jest kłopotliwy. Systemowe wady płyty winylowej i wkładki gramofonowej, która często nie jest właściwie dopasowana do przedwzmacniacza to nie koniec problemów. Wkładkę gramofonu trzeba dopasować do przedwzmacniacza, albo na odwrót, ale wkładkę trzeba dopasować także do ramienia gramofonu.

Ramiona gramofonów charakteryzują się kilkoma parametrami, nie tylko długością. To czy ramię ma 9 czy 12 cali nie ma znaczenia. Ważna jest jego masa efektywna. Nie można użyć takiej samej wkładki do ramion 10 i 35 gramów.

Zupełnie osobne zagadnienie to regulacja wkładki i gramofonu. Paradoksalnie im większa precyzja ustawienia nacisku igły, tym większe problemy z jakością dźwięku. Okazuje się bowiem, że spora część użytkowników gramofonów kurczowo trzyma się dolnej granicy nacisku. Jeśli producent podaje tolerancję 2-2,5 grama, większość stara się ustawić 2 gramy. Tymczasem lepszym rozwiązaniem jest ustawienie 2,5 grama. Zdarza się natrafić na ripy płyt winylowych, które powinny brzmieć dobrze, bo sprzęt użyty do ich zrobienia był bardzo dobrej jakości, ale niestety zniekształcenia np. sybilantów są bardzo duże z powodu ustawienia za małego nacisku igły. Często też zdarza się złe ustawienie wkładki, przeważnie w środku zakresu regulacji, co nie zawsze się sprawdza. Znając typ gramofonu i wkładki można stwierdzić, że właściciel nie wykonał regulacji poprawnie.

W stosunku do zapisu cyfrowego i mechanicznego stosuje się dwa standardy oceny. Z jednej strony wyszukuje się i wyolbrzymia minimalne zniekształcenia w standardzie cyfrowym, a z drugiej stara się nie widzieć poważnych niedoskonałości zapisu mechanicznego. Mało kto wie, że sama płyta gramofonowa ma działanie mikrofonowe, które powoduje mniejsze lub większe zniekształcenia.

Chodzi o to, że dźwięk z głośników i w ogóle dźwięk z otoczenia powoduje drgania winylu, które są przetwarzane przez wkładkę. Efekt mikrofonowy jest dość silny i każdy może, a nawet powinien przekonać się, jak działa w praktyce.

Do testu efektu mikrofonowego potrzebny jest gramofon, który może nawet być uszkodzony i niekompletny. Gramofon musi mieć talerz z matą oraz ramię z wkładką. Napęd może być popsuty, igła może być złamana, wspornik igły wygięty. Liczy się to, że okablowanie jest sprawne.

Trzeba założyć płytę na talerz i opuścić ramię na płytę. Samego gramofonu nie trzeba poziomować itp. wystarczy go tylko podłączyć do wzmacniacza. Do wyjścia wzmacniacza, które można użyć do nagrywania, podłącza się komputer. W programie do nagrywania ustawić trzeba poziom nagrania odpowiedni do pozostałych źródeł dźwięku, a jeśli gramofon jest sprawny, można ustawić poziom nagrywania dla samego gramofonu.

Test polega na tym, że przełącza się wzmacniacz na gramofon, włącza nagrywanie w komputerze i po opuszczeniu ramienia na płytę, ale bez włączania obrotów - płyta nie może się kręcić - mówi się w stronę płyty zupełnie, jak do mikrofonu. Można mówić, śpiewać, deklamować.

Okazuje się, że na tak wykonanym nagraniu wyraźnie słychać słowa, słychać melodię itd. Zrozumiałość jest słaba, głośność mała, zupełnie jakby się słuchało przez ścianę, ale jednak, efekt mikrofonowania przez płytę jest wyraźny i dosyć silny. Jeśli się śpiewa lub mówi głośno, można zauważyć na wskaźnikach poziom dźwięku - 50 a nawet - 40 dB. Można również spróbować nagrać efekt przy odtwarzaniu głośnej muzyki. Taki test jednak jest bardziej skomplikowany, bo potrzebujemy zestawu, który będzie odtwarzał muzykę i przynajmniej dodatkowego wzmacniacza do którego podłączymy gramofon i z którego wyjścia będziemy mogli nagrywać.

Wobec tego okazuje się, że im głośniej się słucha, tym więcej zniekształceń mikrofonowych. W czasie słuchania muzyki są one raczej niemożliwe do zauważenia, chyba że gramofon sprzęga, jednak one są. Test z nagraniem efektu mikrofonowego wykazuje jednak dobitnie niedoskonałość zapisu mechanicznego. Warto podkreślić: bez trudu można spowodować zakłócenia na poziomie 40 dB poniżej sygnału użytecznego. Mikrofonowanie płyty jest dużo trudniejsze do wyłapania niż przesłuchy pomiędzy sąsiednimi rowkami.

Na koniec jeszcze raz wróćmy do "ciepłego dźwięku płyty winylowej". Jest on faktem i wynika przede wszystkim z niemożności zapisania na płycie góry pasma o normalnej głośności, a po części z rezonansów ramienia, korpusu gramofonu, efektu mikrofonowego itp. Jednak dla ogromnej większości użytkowników gramofonów w latach 70/80 ubiegłego wieku ten termin nie przyszedłby nigdy do głowy. Przede wszystkim polskie wkładki miały duże zniekształcenia, co potwierdzano pomiarami, miały kiepskie zawieszenie wspornika, co skutkowało rezonansem silniejszym niż w zachodnich produktach. Ale przede wszystkim te wkładki były typu MM i można stwierdzić, że problem podbicia wysokich tonów był powszechny. Płyty analogowe w tamtych czasach nie brzmiały ciepło.

Wynalezienie wkładki MC prawdopodobnie nie wynikało z potrzeby podniesienia jakości dźwięku, bo różnicy pomiędzy typem MM i MC raczej nie da się usłyszeć, ale właśnie dlatego, żeby uniknąć problemów z nieodpowiednią pojemnością kabla, przedwzmacniacza itp. Źle dopasowane pojemności i podbicie wysokich tonów skutkują dźwiękiem ostrym i twardym, który można określić na wszelkie sposoby, ale "ciepło" nie będzie oddawało charakteru dźwięku.

Największy problem z winylem polega na tym, że wszystkie wady i ograniczenia da się obejść przez przejście na system cyfrowy. Zamiast walczyć z kurzem, zużywaniem się płyty, szumem, trzaskami, stukami, zniekształceniami itd. można użyć odtwarzacza cyfrowego i wszystkie te problemy znikają, a jakość dźwięku znacznie się poprawia.

Mechaniczny zapis na płycie winylowej jest obarczony wieloma mankamentami, to samo dotyczy odczytu takich płyt. Jednak każdy przyzna, że winyl nie brzmi źle. Może z wyjątkiem ostatnich kilku minut zapisu na stronie. Ale to wynika z niedoskonałości słuchu. Gdybyśmy mieli trochę lepszy słuch, nikt nie chciałby używać płyt winylowych. Słyszymy jednak na tyle nieprecyzyjnie, że większości zniekształceń nie jesteśmy w stanie wychwycić.